✨ MIT의 업데이트된 SEAL 기술을 통해 자체 개선 언어 모델이 현실화되고 있습니다

★ IT/기술 전문 정보 ★

매사추세츠 공과대학(MIT)의 연구원들은 ChatGPT 및 대부분의 최신 AI 챗봇을 뒷받침하는 LLM(대형 언어 모델)을 허용하는 기술을 개발하고 오픈 소스화하여 미세 조정할 합성 데이터를 생성함으로써 스스로를 향상시킬 수 있는 기술을 개발하고 오픈 소스화하는 데 새로운 관심을 받고 있습니다. SEAL(Self-Adapting LLM)로 알려진 이 기술은 6월에 출판된 논문에서 처음 설명되었으며 당시 VentureBeat에서 다루었습니다. 크게 확장되고 업데이트된 버전의 논문이 지난 달 공개되었으며 오픈 소스 코드가 Github에

🎯 핵심 특징

✅ 고품질

검증된 정보만 제공

⚡ 빠른 업데이트

실시간 최신 정보

💎 상세 분석

전문가 수준 리뷰

📖 상세 정보

핵심 내용

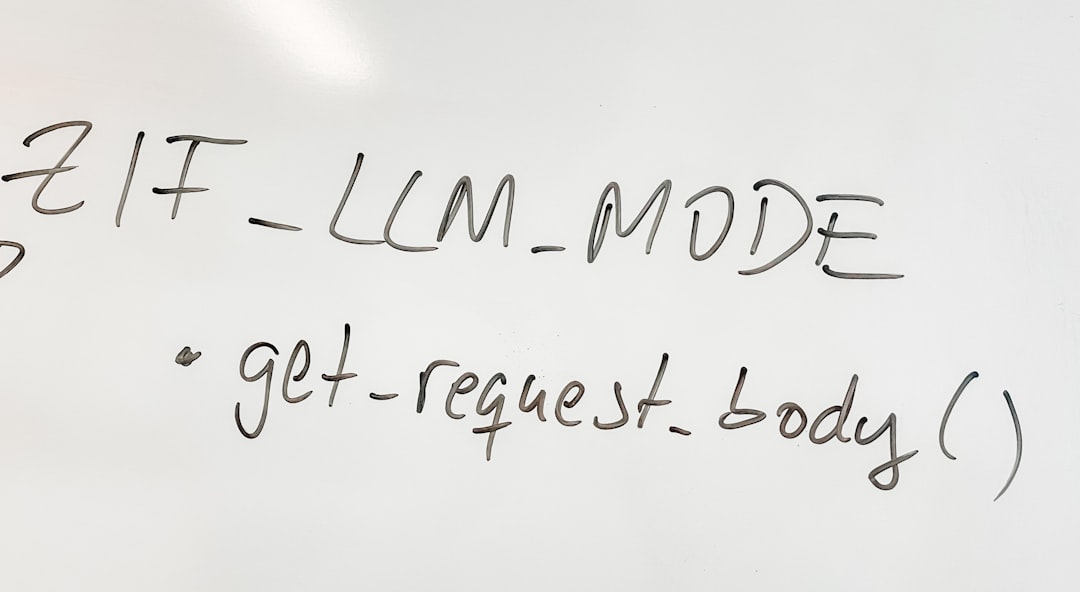

매사추세츠 공과대학(MIT)의 연구원들은 ChatGPT 및 대부분의 최신 AI 챗봇을 뒷받침하는 LLM(대형 언어 모델)을 허용하는 기술을 개발하고 오픈 소스화하여 미세 조정할 합성 데이터를 생성함으로써 스스로를 향상시킬 수 있는 기술을 개발하고 오픈 소스화하는 데 새로운 관심을 받고 있습니다. SEAL(Self-Adapting LLM)로 알려진 이 기술은 6월에 출판된 논문에서 처음 설명되었으며 당시 VentureBeat에서 다루었습니다. 크게 확장되고 업데이트된 버전의 논문이 지난 달 공개되었으며 오픈 소스 코드가 Github에 게시되었으며(MIT 라이센스에 따라 상업 및 기업 사용 가능) 이번 주 소셜 네트워크 X의 AI 고급 사용자들 사이에 새로운 물결을 일으키고 있습니다. SEAL을 사용하면 LLM이 자율적으로 자신만의 미세 조정 전략을 생성하고 적용합니다. 고정된 외부 데이터와 인간이 만든 최적화 파이프라인에 의존하는 기존 모델과 달리 SEAL은 자체 합성 훈련 데이터와 해당 최적화 지시문을 생성하여 모델을 진화시킬 수 있습니다

상세 분석

. 개발은 Adam Zweiger, Jyothish Pari, Han Guo, Ekin Akyürek, Yun Kim 및 Pulkit Agrawal을 포함하여 MIT Improbable AI Lab 소속 팀에서 이루어졌습니다. 그들의 연구는 최근 제39차 신경 정보 처리 시스템 컨퍼런스(NeurIPS 2025)에서 발표되었습니다. 배경: “정적 AI를 넘어서”에서 자가 적응형 시스템까지 올해 초 VentureBeat는 언어 모델이 자체 합성 데이터를 생성하고 훈련할 수 있는 초기 단계 프레임워크로 SEAL에 대해 처음 보고했습니다. 이는 일단 배포된 사전 훈련된 모델의 정체에 대한 잠재적인 해결책입니다.

정리

그 단계에서 SEAL은 엔터프라이즈 AI 에이전트가 수동 재교육 없이 동적 환경에서 지속적으로 학습할 수 있는 개념 증명으로 구성되었습니다. 그 이후로 연구가 상당히 발전했습니다. 새 버전은 SEAL의 자체 적응 능력이 모델 크기에 따라 확장되고, 강화 학습을 보다 효과적으로 통합하여 치명적인 망각을 줄이고, 재현성을 위해 SEAL의 이중 루프 구조(내부 감독 미세 조정 및 외부 강화 최적화)를 공식화함으로써 이전 프레임워크를 확장합니다. 업데이트된 문서에서는 또한 다양한 프롬프트 형식에 대한 평가, 학습 주기 중 향상된 안정성, 추론 시 실제 배포 문제에 대한 논의를 소개합니다. 정적 모델의 한계 해결 LLM은 텍스트 생성 및 이해 분야에서 놀라운 능력을 입증했지만 새로운 작업에 대한 적응

❓ 자주 묻는 질문

Q. 어떤 정보를 제공하나요?

A. IT/기술 관련 최신 정보를 제공합니다.

Q. 신뢰할 수 있나요?

A. 검증된 출처만 선별합니다.

Q. 더 궁금한 점은?

A. 댓글로 문의하세요.

📰 원문 출처

이 글은 원본 기사를 참고하여 작성되었습니다.

🔗 이 글과 함께 읽으면 좋은 글

-

→ Rose Rock Bridge가 오클라호마 주 털사에서 에너지의 미래를 구축하는 방법

2025-10-15

-

→ Visa는 방금 AI 쇼핑 붐을 확보하기 위한 프로토콜을 출시했습니다. 이것이 판매자에게 의미하는 바는 다음과 같습니다

2025-10-15

-

→ EAGLET는 맞춤형 계획을 생성하여 더 긴 범위의 작업에서 AI 에이전트 성능을 향상합니다

2025-10-15

-

→ OpenAI는 5년 안에 130억 달러를 1조 달러로 전환할 것입니다

2025-10-15

-

→ 인터넷을 수리할 수 있나요?

2025-10-15

댓글